Never Ask ChatGPT These 5 Things: आजकल Gen Z युवा अपनी बातचीत के कौशल, सैलरी बढ़ाने की नेगोशिएशन और ऑफिस के मुश्किल संघर्षों को सुलझाने के लिए ChatGPT को ‘रिहर्सल पार्टनर’ बना रहे हैं। फॉर्च्यून और डेलॉइट सर्वे के ताजा आंकड़ों के मुताबिक, युवा प्रोफेशनल्स अब बॉस से ज्यादा AI से कठिन बातचीत की प्रैक्टिस कर रहे हैं। लेकिन विशेषज्ञों का कहना है कि यह ट्रेंड खतरनाक भी हो सकता है।

पिछले 48 घंटों में वायरल हुई फर्स्टपोस्ट की ‘वैंटेज विद पल्की शर्मा’ रिपोर्ट और फॉर्च्यून के लेख में ठीक यही चेतावनी दी गई है कि AI बेहतरीन टूल है, लेकिन कुछ सीमाएं और खतरे भी हैं। OpenAI के CEO सैम ऑल्टमैन ने खुद कहा है कि “AI से खुशी कैसे पाएं” जैसा सवाल भी कभी न पूछें।

यहाँ हैं वे 5 महत्वपूर्ण चीजें जो आपको ChatGPT या किसी भी AI चैटबॉट से कभी नहीं पूछनी चाहिए:

1. अत्यंत व्यक्तिगत या संवेदनशील डेटा (Personal or Sensitive Data)

पासवर्ड, बैंक अकाउंट डिटेल्स, क्रेडिट कार्ड नंबर, फोन नंबर या ऑफिस के गोपनीय दस्तावेज़ कभी भी AI में न डालें। हाल ही में हफपोस्ट और फोर्ब्स की रिपोर्ट्स में चेतावनी दी गई है कि ChatGPT की चैट्स प्राइवेट नहीं हैं। एक बार डेटा क्लाउड पर चला गया तो वह आपके कंट्रोल में नहीं रहता। हैकर्स या कानूनी जांच में यह आपके खिलाफ इस्तेमाल हो सकता है।

2. थेरेपी या चिकित्सा संबंधी सलाह (Therapy and Medical Questions)

लाखों युवा अब AI को ‘थेरेपिस्ट’ मानकर अपनी मानसिक स्वास्थ्य या शारीरिक समस्याओं पर चर्चा कर रहे हैं। लेकिन ब्राउन यूनिवर्सिटी की मार्च 2026 की स्टडी में खुलासा हुआ है कि ChatGPT नैतिक नियम तोड़ता है और गलत सलाह दे सकता है। यह HIPAA कंप्लायंट नहीं है। डॉक्टर या लाइसेंस्ड थेरेपिस्ट की जगह AI कभी नहीं ले सकता—यह आपकी सेहत के लिए खतरनाक साबित हो सकता है।

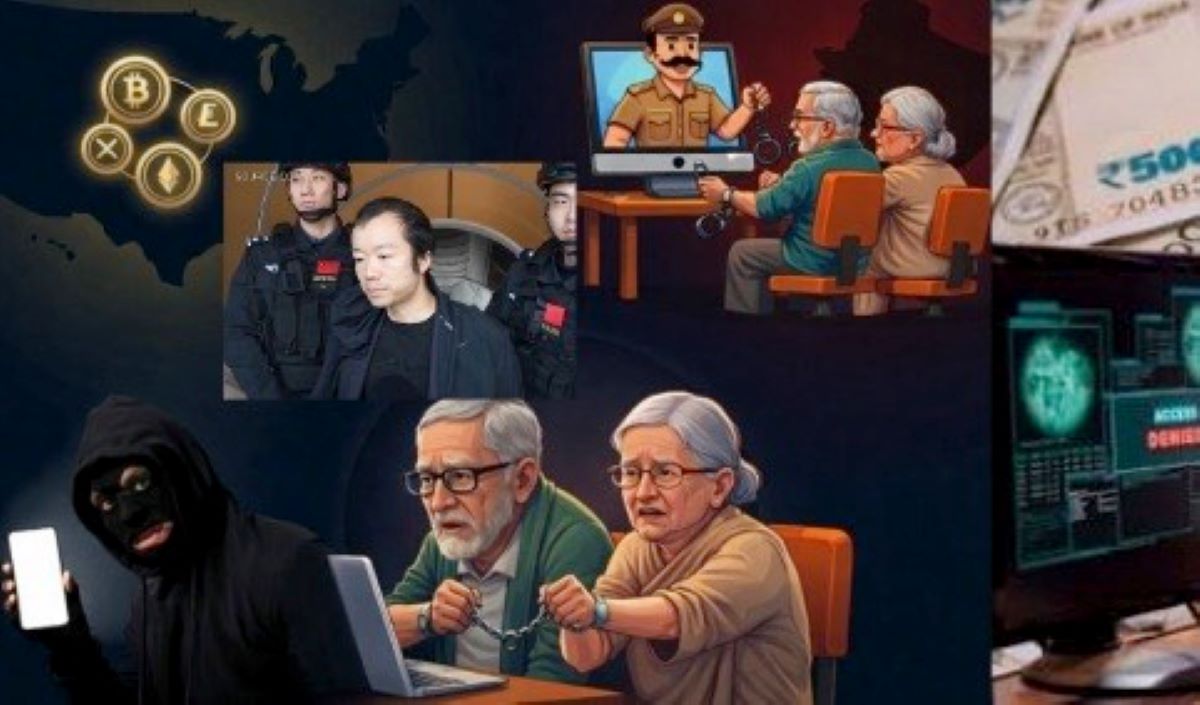

3. अवैध या खतरनाक काम (Illegal or Dangerous Things)

हैकिंग, फ्रॉड, हानिकारक वस्तु बनाने या कोई क्राइम कैसे करें—ऐसे सवाल बिल्कुल न पूछें। AI कंपनियां ऐसी गतिविधियों पर नजर रखती हैं और फ्लैग कर देती हैं। फोर्ब्स और USA टुडे की हालिया रिपोर्ट्स में साफ कहा गया है कि इससे कानूनी मुसीबत हो सकती है। AI की टर्म्स ऑफ सर्विस भी इसे मना करती है।

4. साजिश के सिद्धांत या हेलुसिनेशन वाले टॉपिक (Conspiracy Theories)

AI अक्सर ‘हैलुसिनेट’ करता है—यानी गलत जानकारी को तथ्य की तरह पेश कर देता है। 2026 में भी LLMs में यह समस्या बनी हुई है (ड्यूक यूनिवर्सिटी रिपोर्ट)। साजिश सिद्धांतों पर चर्चा करने से आप गलत सूचनाओं के जाल में फंस सकते हैं। AI कांस्पिरेसी थ्योरिस्ट का रोल प्ले करके भी गलत जानकारी फैला सकता है।

5. जीवन के वास्तविक मानवीय निर्णय (Real Human Decisions)

“नौकरी छोड़ दूं या नहीं?”, “रिश्ता खत्म कर दूं?”, “यह ऑफर स्वीकार करूं या नहीं?”—ऐसे फैसले AI पर छोड़ने की भूल न करें। AI आपकी भावनाओं, व्यक्तिगत इतिहास और जीवन की जटिलताओं को नहीं समझता। फॉर्च्यून की 22 मार्च 2026 रिपोर्ट में Gen Z को सलाह दी गई है कि AI सिर्फ प्रैक्टिस के लिए इस्तेमाल करें, फैसला खुद लें।

निष्कर्ष:

AI भविष्य है और सैलरी नेगोशिएशन या टफ कॉन्वर्सेशन की तैयारी में मददगार साबित हो रहा है, लेकिन इसे अपना डॉक्टर, वकील, साथी या थेरेपिस्ट न बनाएं। डेलॉइट सर्वे के मुताबिक Gen Z में 49% युवा अब बॉस से ज्यादा ChatGPT पर भरोसा करते हैं, लेकिन विशेषज्ञ चेतावनी देते हैं—सवाल यह नहीं है कि AI क्या कर सकता है, बल्कि यह है कि आपको इसके साथ क्या साझा करना चाहिए।

जांचकर्ताओं और साइबर एक्सपर्ट्स की सलाह: AI को सिर्फ जनरल जानकारी या आइडिया ब्रेनस्टॉर्मिंग के लिए इस्तेमाल करें। असली फैसले हमेशा इंसान ही लें।